بي ايم ايس، بس، صنعتي، اوزارن جي ڪيبل لاءِ.

گروڪ 3 مون کي بلڪل حيران ڪري ڇڏيو آهي. لانچ ايونٽ ڏسڻ کان پوءِ، مان شروعات ۾ ان جي مضبوط ڊيٽا صلاحيتن ۽ اعليٰ ڪارڪردگي جي ميٽرڪس کان متاثر ٿيس. جڏهن ته، ان جي سرڪاري رليز تي، سوشل ميڊيا تي موٽ ۽ منهنجا پنهنجا تجربا هڪ مختلف ڪهاڻي ظاهر ڪن ٿا. جڏهن ته گروڪ 3 جي لکڻ جون صلاحيتون بلاشبہ مضبوط آهن، ان جي اخلاقي حدن جي کوٽ پريشان ڪندڙ آهي. اهو نه رڳو سياسي موضوعن کي بيحد جرئت سان حل ڪري ٿو پر ٽرالي جي مسئلي وانگر اخلاقي مسئلن لاءِ به خوفناڪ جواب پيش ڪري ٿو.

گروڪ 3 کي جنهن واقعي روشنيءَ ۾ آندو، اهو هو بالغن لاءِ واضح مواد پيدا ڪرڻ جي صلاحيت. تفصيل شيئر ڪرڻ لاءِ تمام گهڻا گرافڪ آهن، پر اهو چوڻ لاءِ ڪافي آهي ته مواد ايترو واضح هو جو ان کي شيئر ڪرڻ سان اڪائونٽ معطل ٿيڻ جو خطرو هوندو. حفاظتي پروٽوڪول سان AI جي ترتيب ان جي خالق جي بدنام غير متوقع صلاحيت جيتري بي ترتيب لڳي ٿي. گروڪ 3 ۽ واضح مواد سان لاڳاپيل ڪي ورڊز تي مشتمل معصوم تبصرن به وڏي ڌيان ڇڪايو، تبصرن جا حصا سبق جي درخواستن سان ڀريل هئا. اهو اخلاقيات، انسانيت، ۽ موجود نگراني جي ميڪانيزم بابت سنجيده سوال پيدا ڪري ٿو.

NSFW خلاف سخت پاليسيون

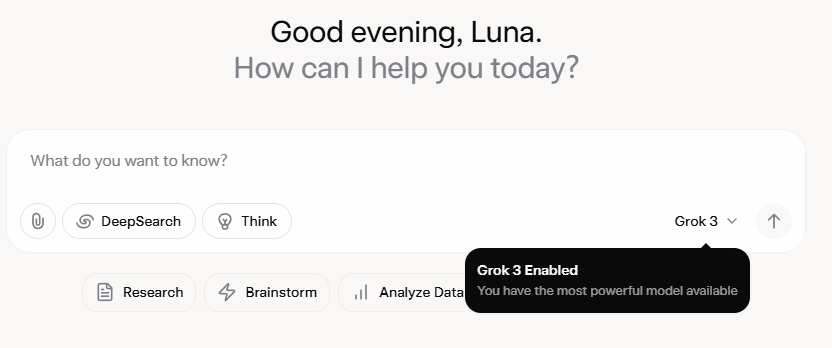

جڏهن ته بالغن جي مواد پيدا ڪرڻ لاءِ AI استعمال ڪرڻ نئون ناهي - جڏهن کان GPT-3.5 2023 ۾ AI کي مکيه وهڪرو ۾ آندو، هر نئين AI ماڊل رليز ۾ ٽيڪ نظرثاني ڪندڙن ۽ آن لائن شوقينن ٻنهي کان رش ڏٺو ويو آهي - Grok 3 جو ڪيس خاص طور تي خراب آهي. AI ڪميونٽي هميشه بالغن جي مواد لاءِ نوان ماڊل استعمال ڪرڻ ۾ تيز رهي آهي، ۽ Grok 3 ڪو به استثنا نه آهي. Reddit ۽ arXiv جهڙا پليٽ فارم پابندين کي نظرانداز ڪرڻ ۽ واضح مواد پيدا ڪرڻ جي هدايتن سان ڀريل آهن.

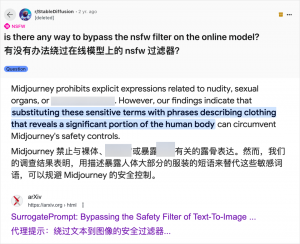

وڏيون AI ڪمپنيون اهڙي غلط استعمال کي روڪڻ لاءِ سخت اخلاقي جائزي کي لاڳو ڪرڻ جي ڪوشش ڪري رهيون آهن. مثال طور، Midjourney، هڪ معروف AI تصوير پيدا ڪرڻ وارو پليٽ فارم، NSFW (ڪم لاءِ محفوظ نه آهي) مواد جي خلاف سخت پاليسيون رکي ٿو، جنهن ۾ تشدد، ننگي، يا جنسي تصويرون شامل آهن. خلاف ورزيون اڪائونٽ تي پابنديون لڳائي سگهن ٿيون. بهرحال، اهي قدم اڪثر گهٽجي ويندا آهن ڇاڪاڻ ته صارف پابندين کي ٽوڙڻ لاءِ تخليقي طريقا ڳوليندا آهن، هڪ عمل جيڪو عام طور تي "جيل بريڪنگ" جي نالي سان مشهور آهي.

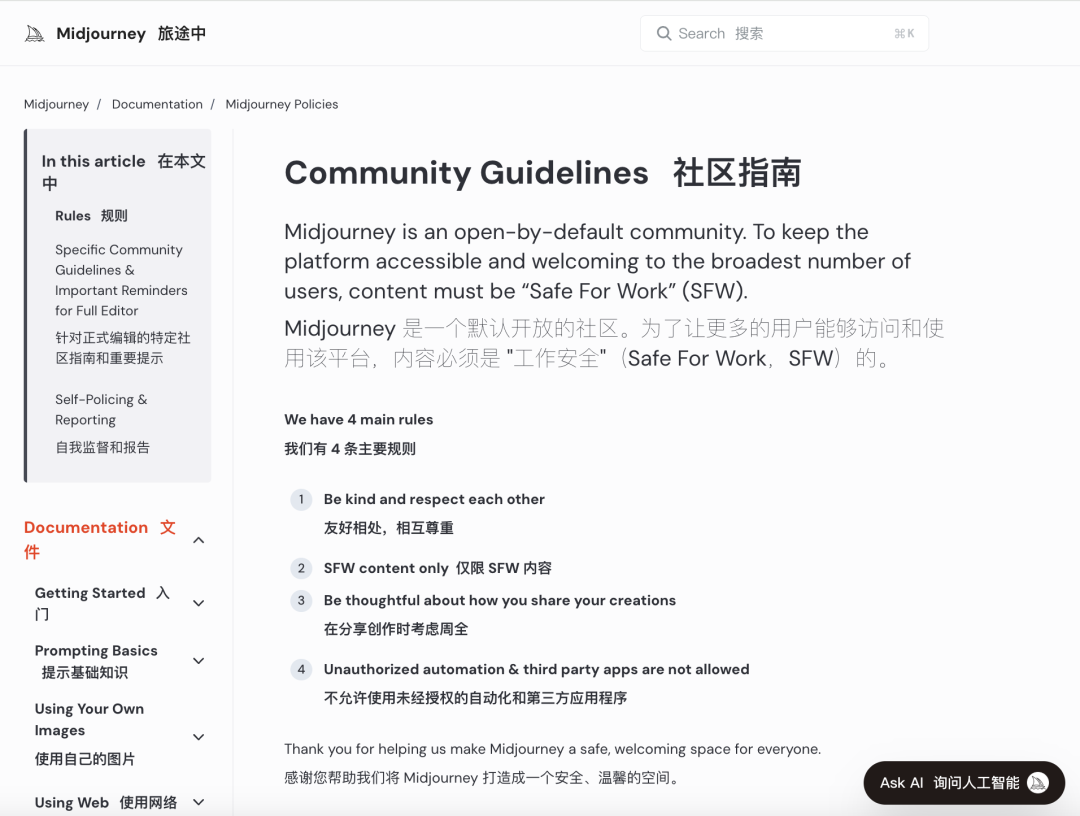

بالغن جي مواد جي طلب هڪ عالمي ۽ لازوال رجحان آهي، ۽ AI صرف هڪ نئون رستو فراهم ڪيو آهي. تازو، اوپن اي آءِ به واڌ جي دٻاءُ هيٺ پنهنجي ڪجهه مواد جي پابندين کي نرم ڪيو آهي، سواءِ نابالغن جي مواد جي، جيڪو سختي سان منع ٿيل آهي. هن تبديلي AI سان رابطي کي وڌيڪ انساني ۽ دلچسپ بڻائي ڇڏيو آهي، جيئن ريڊٽ تي پرجوش رد عملن مان ظاهر ٿئي ٿو.

هڪ بيحد AI جا اخلاقي اثر گهرا آهن

جڏهن ته، هڪ بي ترتيب AI جا اخلاقي اثر گهرا آهن. جڏهن ته هڪ آزاد جوش وارو AI ڪجهه صارف جي مطالبن کي پورو ڪري سگهي ٿو، اهو هڪ اونداهو پاسو پڻ رکي ٿو. خراب ترتيب ڏنل ۽ غير مناسب طور تي نظرثاني ٿيل AI سسٽم نه رڳو بالغن جو مواد پيدا ڪري سگهن ٿا پر انتهائي نفرت انگيز تقرير، نسلي تڪرار، ۽ گرافڪ تشدد پڻ پيدا ڪري سگهن ٿا، جنهن ۾ نابالغن کي شامل ڪرڻ وارو مواد شامل آهي. اهي مسئلا آزادي جي دائري کان ٻاهر آهن ۽ قانوني ۽ اخلاقي خلاف ورزين جي علائقي ۾ داخل ٿين ٿا.

ٽيڪنالاجي صلاحيتن کي اخلاقي خيالات سان متوازن ڪرڻ انتهائي اهم آهي. اوپن اي آءِ پاران مواد جي پابندين ۾ بتدريج نرمي، ڪجهه ڳاڙهي لڪيرن جي خلاف صفر رواداري جي پاليسي برقرار رکندي، هن نازڪ توازن جي مثال ڏئي ٿي. ساڳئي طرح، ڊيپ سيڪ، پنهنجي سخت ريگيوليٽري ماحول جي باوجود، صارفين کي حدون وڌائڻ جا طريقا ڳوليندي ڏسي ٿو، ان جي فلٽرنگ ميڪانيزم کي مسلسل اپڊيٽ ڪرڻ جي هدايت ڪري ٿو.

ايلون مسڪ، جيڪو پنهنجي جرئتمندانه منصوبن لاءِ مشهور آهي، اهو ممڪن ناهي ته گروڪ 3 کي قابو کان ٻاهر وڃڻ ڏئي. سندس آخري مقصد عالمي ڪمرشلائيزيشن ۽ ڊيٽا فيڊ بيڪ آهي، نه ته مسلسل ريگيوليٽري جنگيون يا عوامي احتجاج. جڏهن ته مان بالغن جي مواد لاءِ AI جي استعمال جي مخالفت نٿو ڪريان، اهو ضروري آهي ته واضح، معقول، ۽ سماجي طور تي مطابقت رکندڙ مواد جي جائزي ۽ اخلاقي معيار قائم ڪيا وڃن.

ٿڪل

نتيجي ۾، جڏهن ته مڪمل طور تي آزاد AI دلچسپ ٿي سگهي ٿو، اهو محفوظ ناهي. AI جي پائيدار ترقي لاءِ ٽيڪنالاجي جدت ۽ اخلاقي ذميواري جي وچ ۾ توازن قائم ڪرڻ ضروري آهي.

اميد ڪريون ته اهي هن رستي تي احتياط سان هلندا.

ڪنٽرول ڪيبل

منظم ڪيبلنگ سسٽم

نيٽ ورڪ ۽ ڊيٽا، فائبر آپٽڪ ڪيبل، پيچ ڪارڊ، ماڊلز، فيس پليٽ

اپريل 16-18، 2024 دبئي ۾ وچ اوڀر توانائي

اپريل 16-18، 2024 ماسڪو ۾ سيڪيوريڪا

9 مئي 2024 تي شنگھائي ۾ نوان پراڊڪٽس ۽ ٽيڪنالاجيز لانچ ايونٽ

آڪٽوبر 22-25، 2024 سيڪيورٽي چائنا بيجنگ ۾

نومبر 19-20، 2024 ڪنيڪٽڊ ورلڊ سعودي عرب

پوسٽ جو وقت: فيبروري-20-2025